Publicaciones 'deepfake' o contenido porno creado con Inteligencia Artificial: ¿Qué hacer si somos víctimas?

Las publicaciones 'deepfake' o contenido porno creado con IA se ha convertido en la nueva amenaza de la Red

Si recibes ese contenido y lo redifundes podrías enfrentarte a condenas de hasta tres años de prisión

Denuncian en Madrid dos falsos desnudos de menores creados con inteligencia artificial

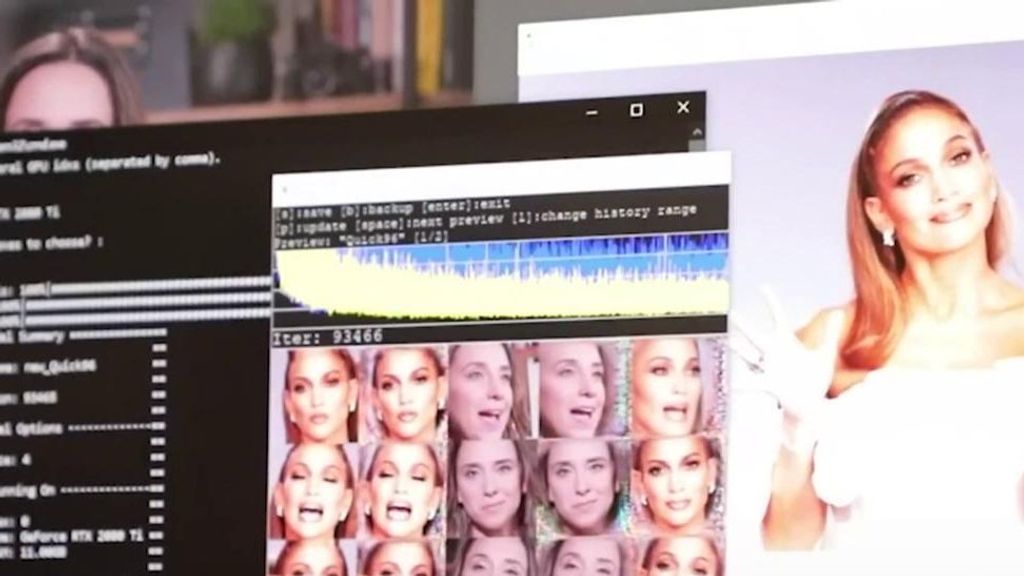

El contenido pornográfico generado con Inteligencia Artificial, en el que se suplanta sin consentimiento a una persona -como ha ocurrido con las menores en Almendralejo-, continúa planteando dilemas sobre cómo actuar legalmente ante unas creaciones que van en aumento. Sobre todo, contra mujeres adultas. Sin una ley específica, de momento, hemos querido conocer qué se puede hacer para frenar y condenar su creación y difusión.

Otra de las víctimas que no ha dudado en denunciar esta práctica que ha sufrido ha sido la 'streamer' estadounidense QTCinderella, una de tantas celebridades suplantadas recientemente con Inteligencia Artificial en este tipo de contenido en páginas. "No debería ser parte de mi trabajo pagar parte de mi dinero para retiren estas cosas", denunciaba ella misma en uno de sus directos.

MÁS

La IA aumentará la productividad pero también las tensiones sociales y políticas, según un estudio

El joven de 16 años de Ayamonte usó photoshop para hacer los montajes de compañeras: a qué pena se enfrenta

Caso Almendralejo: 10 menores identificados por los desnudos con inteligencia artificial, algunos imputables

El cortafuegos legal para acabar con el contenido 'deepfake'

Es más, estos contenidos llegan a formar parte de categorías de portales porno donde se cuelgan contenido creado por Inteligencia Artificial en el que aparecen las supuestas 'celebrities' o famosas en vídeos hiperrealistas. Muchas actrices y famosas han intentando luchar contra esta práctica. Sin embargo, han abandonado la lucha porque les es muy difícil borrar este contenido de la Red.

La Unión Europea ya trabaja en un cortafuegos legal para identificar al creador de todo contenido 'deepfake', con el reto titánico, eso sí, ante servidores extranjeros y la difusión masiva por mensajería encriptada. Las creaciones que acaban siendo imágenes sexuales no consentidas afectan en un 90% a mujeres.

¿Qué hacer si somos víctimas de este contenido 'deepfake'?

A sus víctimas en España se les recomienda seguir unos pasos para denunciar y conseguir que se elimine dicho contenido.

- Identificar y guardar todas las pruebas digitales al alcance.

- Solicitar su retirada urgente en el canal prioritario de la Agencia Estatal de Protección de Datos, que puede imponer multas a sus responsables.

Por su parte, el instituto INCIBE dispone, además, de una línea gratuita de asesoramiento. Sin olvidar, por supuesto, presentar la denuncia a la vez ante la Policía Nacional o la Guardia Civil.

En casos con menores como las de Almendralejo, cabría el delito de pornografía infantil aún siendo imágenes generadas por ordenador. Sin embargo, su creación no consentida con adultos en España sin una ley específica, de momento rechazada en el Congreso, es interpretable en su castigo.

"Si se pudiera aplicar el 197, que son los delitos contra la intimidad y la propia imagen, lo que es la generación de la imagen sería un delito de hasta cuatro años. Si el mismo que la ha captado o la difunde se subiría un año", apuntan los expertos.

Los primeros en recibir ese contenido, si conocen su origen ilícito y lo redifunden, también podrían enfrentarse a condenas de hasta tres años de prisión.